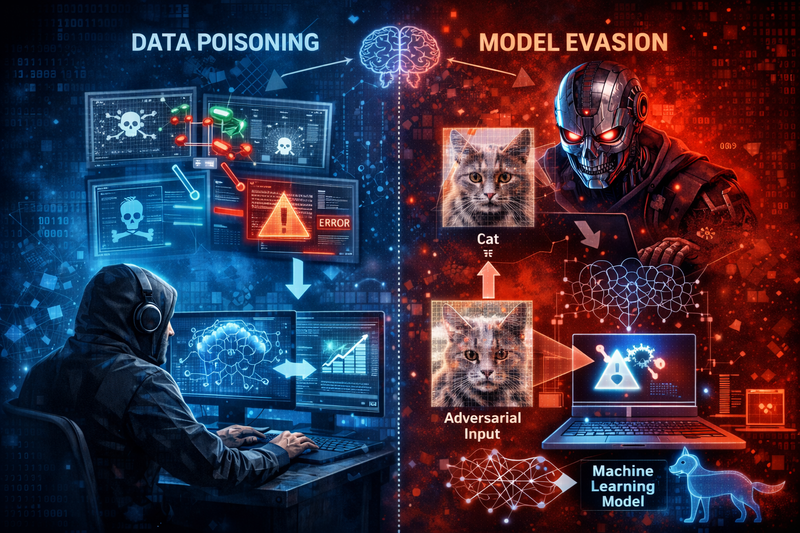

Data Poisoning dan Model Evasion dalam Penyerangan Siber Berbasis Kecerdasan Buatan

22-Jan-2026

Data Poisoning dan Model Evasion dalam Penyerangan Siber Berbasis Kecerdasan Buatan

Pendahuluan

Pemanfaatan kecerdasan buatan (Artificial Intelligence/AI) dan machine learning (ML) dalam sistem keamanan siber semakin luas, mulai dari deteksi intrusi, klasifikasi malware, hingga analisis perilaku jaringan. Sistem berbasis AI menawarkan kemampuan adaptif dan proaktif yang jauh melampaui metode keamanan tradisional. Namun, ketergantungan pada AI juga menghadirkan jenis ancaman baru yang secara spesifik menargetkan model pembelajaran mesin itu sendiri. Dua teknik penyerangan yang paling signifikan dalam konteks ini adalah data poisoning dan model evasion. Keduanya merupakan bentuk serangan siber tingkat lanjut yang berfokus pada manipulasi proses pembelajaran dan pengambilan keputusan model AI, sehingga sistem keamanan dapat dilumpuhkan tanpa harus menembus infrastruktur secara langsung.

Peran AI dalam Keamanan Siber Modern

Sebelum membahas lebih jauh tentang data poisoning dan model evasion, penting untuk memahami peran AI dalam keamanan siber. Sistem AI digunakan untuk mempelajari pola lalu lintas jaringan normal, mengidentifikasi anomali, serta memprediksi potensi serangan berdasarkan data historis. Model pembelajaran mesin bekerja dengan memanfaatkan data pelatihan dalam jumlah besar untuk membangun representasi statistik dari perilaku normal dan berbahaya.

Keunggulan utama AI adalah kemampuannya dalam mengenali serangan baru (unknown threats) yang belum memiliki signature khusus. Namun, justru karena sifatnya yang belajar dari data, AI menjadi rentan terhadap manipulasi data dan eksploitasi kelemahan model. Di sinilah data poisoning dan model evasion menjadi ancaman yang sangat berbahaya.

Konsep dan Mekanisme Data Poisoning

Data poisoning adalah teknik serangan yang bertujuan merusak integritas data pelatihan model AI. Dalam serangan ini, penyerang secara sengaja memasukkan data palsu, bias, atau berbahaya ke dalam dataset pelatihan sehingga model mempelajari pola yang salah. Akibatnya, model menghasilkan keputusan yang keliru atau menjadi tidak efektif dalam mendeteksi ancaman.

Serangan data poisoning dapat terjadi pada berbagai tahap siklus hidup model, terutama saat pengumpulan data dan pelatihan ulang (retraining). Dalam konteks keamanan siber, penyerang dapat mengirimkan lalu lintas jaringan yang dirancang secara khusus agar terlihat normal, tetapi sebenarnya berbahaya. Jika lalu lintas tersebut masuk ke dataset pelatihan, model akan menganggap pola tersebut sebagai perilaku sah.

Jenis-Jenis Data Poisoning

Secara umum, data poisoning dapat dibedakan menjadi dua jenis utama. Pertama adalah availability attack, yaitu serangan yang bertujuan menurunkan akurasi model secara keseluruhan. Model menjadi tidak stabil dan menghasilkan banyak kesalahan, sehingga sistem keamanan kehilangan keandalannya.

Kedua adalah integrity attack, yang lebih berbahaya karena menargetkan tujuan tertentu. Dalam serangan ini, penyerang ingin agar aktivitas berbahaya tertentu tidak terdeteksi, sementara kinerja model terhadap data lain tetap terlihat normal. Contohnya, model IDS berbasis AI gagal mendeteksi malware tertentu karena pola tersebut telah “diracuni” dalam data pelatihan.

Konsep dan Mekanisme Model Evasion

Berbeda dengan data poisoning yang menyerang fase pelatihan, model evasion menargetkan fase inferensi atau penggunaan model. Serangan ini dilakukan dengan memodifikasi input secara halus agar dapat melewati mekanisme deteksi AI tanpa terdeteksi sebagai ancaman. Penyerang tidak mengubah model, melainkan mengeksploitasi batas keputusan (decision boundary) yang dipelajari oleh model.

Dalam keamanan siber, model evasion sering digunakan untuk mengelabui sistem deteksi malware atau IDS berbasis AI. Misalnya, malware dimodifikasi sedikit demi sedikit hingga tidak lagi dikenali sebagai berbahaya oleh model, meskipun fungsinya tetap sama.

Teknik Model Evasion dalam Penyerangan Siber

Salah satu teknik umum dalam model evasion adalah adversarial example, yaitu input yang dirancang secara khusus untuk menipu model AI. Perubahan yang dilakukan sering kali sangat kecil dan tidak signifikan secara kasat mata, tetapi cukup untuk mengubah hasil klasifikasi model.

Dalam konteks jaringan, penyerang dapat memodifikasi pola lalu lintas, urutan paket, atau waktu pengiriman agar terlihat seperti aktivitas normal. Pada sistem deteksi malware, penyerang dapat mengubah struktur file atau menambahkan kode tidak berbahaya untuk menghindari deteksi. Teknik ini sangat efektif terhadap model yang tidak dirancang untuk menghadapi input adversarial.

Dampak Data Poisoning dan Model Evasion

Dampak dari data poisoning dan model evasion sangat serius. Sistem keamanan siber yang bergantung pada AI dapat memberikan rasa aman palsu (false sense of security). Serangan dapat berlangsung dalam waktu lama tanpa terdeteksi, menyebabkan kebocoran data, gangguan layanan, atau kerusakan infrastruktur kritis.

Selain itu, serangan ini sulit dideteksi karena tidak selalu menunjukkan gejala yang jelas. Model mungkin masih berfungsi dengan baik pada sebagian besar data, sehingga administrator tidak menyadari adanya manipulasi. Hal ini menjadikan data poisoning dan model evasion sebagai ancaman jangka panjang yang berpotensi merusak kepercayaan terhadap sistem AI.

Strategi Mitigasi dan Pertahanan

Untuk menghadapi data poisoning, diperlukan mekanisme validasi dan sanitasi data yang ketat. Data pelatihan harus diverifikasi dari sumber yang tepercaya dan dipantau secara kontinu untuk mendeteksi anomali. Teknik robust learning dan outlier detection juga dapat membantu mengurangi dampak data berbahaya.

Dalam menghadapi model evasion, pendekatan adversarial training menjadi salah satu solusi utama. Model dilatih menggunakan contoh input adversarial sehingga lebih tahan terhadap upaya pengelabuan. Selain itu, penggunaan model ensemble dan sistem keamanan berlapis (defense in depth) dapat meningkatkan ketahanan terhadap serangan ini.

Tantangan dan Arah Penelitian

Meskipun berbagai teknik mitigasi telah dikembangkan, tantangan dalam menghadapi data poisoning dan model evasion masih sangat besar. Penyerang terus mengembangkan metode yang lebih canggih dan sulit dideteksi. Di sisi lain, peningkatan ketahanan model sering kali berbanding lurus dengan meningkatnya kompleksitas dan biaya komputasi.

Penelitian ke depan difokuskan pada pengembangan explainable AI (XAI) untuk memahami keputusan model, serta metode pembelajaran yang lebih tahan terhadap manipulasi data. Kolaborasi antara peneliti AI dan pakar keamanan siber menjadi kunci dalam menghadapi ancaman ini secara efektif.

Kesimpulan

Data poisoning dan model evasion merupakan dua teknik penyerangan siber yang secara khusus menargetkan kelemahan sistem AI. Dengan memanipulasi data pelatihan dan mengeksploitasi batas keputusan model, penyerang dapat melumpuhkan sistem keamanan tanpa perlu melakukan serangan konvensional. Oleh karena itu, penerapan AI dalam keamanan siber harus disertai dengan strategi pertahanan yang matang, validasi data yang ketat, dan pendekatan keamanan berlapis. Pemahaman mendalam terhadap kedua teknik ini menjadi langkah penting dalam membangun sistem keamanan siber berbasis AI yang andal dan berkelanjutan.

Daftar Pustaka

-

Biggio, B., & Roli, F. (2018). “Wild Patterns: Ten Years After the Rise of Adversarial Machine Learning.” Pattern Recognition, 84, 317–331.

-

Goodfellow, I., Shlens, J., & Szegedy, C. (2015). “Explaining and Harnessing Adversarial Examples.” International Conference on Learning Representations (ICLR).

-

Papernot, N., et al. (2016). “The Limitations of Deep Learning in Adversarial Settings.” IEEE European Symposium on Security and Privacy.

-

Barreno, M., Nelson, B., Joseph, A. D., & Tygar, J. D. (2010). “The Security of Machine Learning.” Machine Learning Journal, 81(2), 121–148.

-

Kshetri, N. (2021). Cybersecurity and Cyberwar. Oxford University Press.

-

ENISA. (2021). Securing Machine Learning Algorithms. European Union Agency for Cybersecurity.

-

NIST. (2023). Adversarial Machine Learning: A Taxonomy and Terminology. National Institute of Standards and Technology.

Recent news

19-Jan-2026

Related news

22-Jan-2026

338 View

Pendahuluan Perkembangan teknologi mobile telah menjadikan smartphone, tablet, dan perangkat...

22-Jan-2026

338 View

Pendahuluan Keamanan jaringan merupakan aspek fundamental dalam pengelolaan sistem informasi...

22-Jan-2026

338 View

Pendahuluan Perkembangan teknologi kecerdasan buatan (Artificial Intelligence/AI) telah membawa...

338 View